Wolfgang M. Heckl_KI-Kunst.BarryWhite.AllofMe.2025 Schon 1911 hat Wassily Kandinsky in seiner „Improvisation III“ mit seiner natürlichen Intelligenz als Künstler interpretiert, was er sah und fühlte während eines Konzerts.

Schon 1911 hat Wassily Kandinsky in seiner „Improvisation III“ mit seiner natürlichen Intelligenz als Künstler interpretiert, was er sah und fühlte während eines Konzerts.

Im 21. Jahrhundert können Computer diesen Prozess übernehmen, sie können sowohl Musik in Kunst überführen als auch die Umkehrtransformation möglich machen….

________________________________________________________________________________________________________________

Also sprach Zarathustra 2, 2024

Aludibond, bedruckt und gebürstet.

Verso signiert, datiert, betitelt und bezeichnet. 100 x100 cm

________________________________________________________________________________________________________________

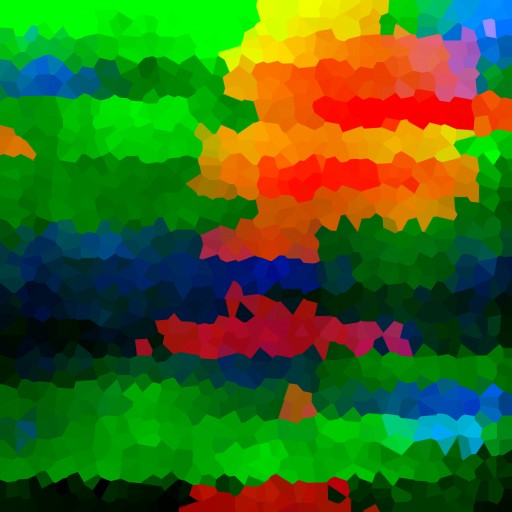

Street fighting Man, 2022

Aludibond, bedruckt und gebürstet.

Verso signiert, datiert, betitelt und bezeichnet. 100 x100 cm

________________________________________________________________________________________________________________

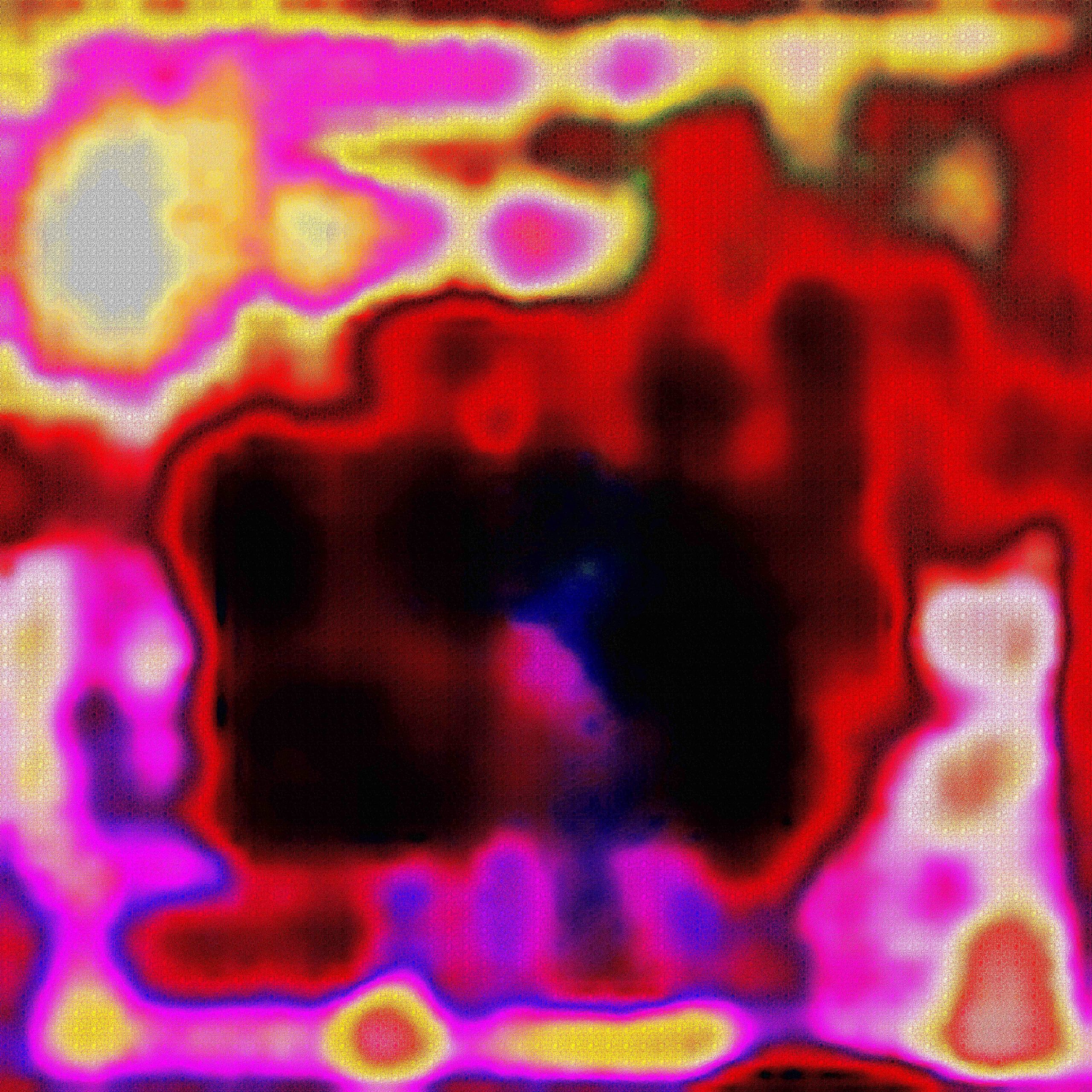

Phantom of the Opera, 2021

Aludibond, bedruckt und gebürstet.

Verso signiert, datiert und bezeichnet. 100 x 120 cm

______________________________________________________________________________________________________

All You Need is Love, 2024

Aludibond, bedruckt und gebürstet.

Verso signiert, datiert und bezeichnet. 120 x 120 cm

________________________________________________________________________________________________________________

Hallelujah, Leonard Cohen, 2023

Aludibond, bedruckt und gebürstet.

Verso signiert, datiert und bezeichnet. 120 x 120 cm

________________________________________________________________________________________________________________

Satisfaction, 2024

Aludibond, bedruckt

Verso signiert, datiert und bezeichnet. 120 x 120 cm

________________________________________________________________________________________________________________

Beethoven „Waldsteinsonate“, 2024

Hochwertiger Photo-Direktdruck auf Aludibond, weiß

Signiert, datiert. 120 x 120 cm

________________________________________________________________________________________________________________

Bolero, 2024

Hochwertiger Photo-Direktdruck auf Aludibond, weiß.

Signiert, datiert und bezeichnet. 100 x 100 cm

________________________________________________________________________________________________________________

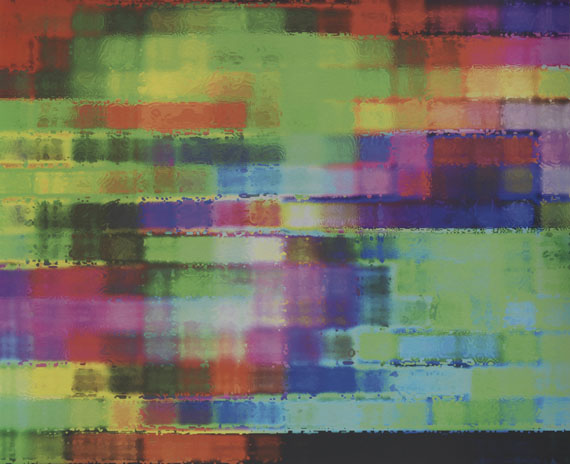

Bach Prelude, 2022

Aludibond, bedruckt und gebürstet.

Signiert, datiert „Heckl | 2020“ 100 x 100 cm

________________________________________________________________________________________________________________

Coronen Dancing KI Musik zu Bild Moleküle, 2024

Rücktransformation aus KI-generierter Musik erstellt von der KI aus original rastertunnelmikroskopischer Aufnahme (Coronen Dancing) in 100 Millionen-facher Vergrößerung

Photodruck auf Leinwand

Signiert, datiert und bezeichnet, 100 x 100 cm

________________________________________________________________________________________________________________

Zarathustra Space, 2024

Aludibond, bedruckt.

Verso signiert, datiert und bezeichnet. 120 x 120 cm

________________________________________________________________________________________________________________

Schon 1911 hat Wassily Kandinsky in seiner „Improvisation III“ mit seiner natürlichen Intelligenz als Künstler interpretiert, was er sah und fühlte während eines Konzerts. Im 21. Jahrhundert können Computer diesen Prozess übernehmen, sie können sowohl Musik in Kunst überführen als auch die Umkehrtransformation möglich machen, so wie z. B. Heckl schon 2006 atomare Landschaften aus seiner rastertunnelmikroskopischen Forschung mithilfe eines analytischen Algorithmus in atomare Klanglandschaften übersetzt hat. (Vgl.: Wolfgang M. Heckl. Atomare Klangwelten. Technical Report 1/2006, Andrea von Braun Stiftung, 2006, und Wolfgang M. Heckl. Moselculism. In Peter Weibel und Ljiljana Fruk, editors, Molecular Aesthetics, pages 361-367. ZKM/Center for Art and Media, Karlsruhe, 2013.)

Bei „Phantom of the Opera“ aus dem Jahr 2021 wurde ein ganz neuer Weg beschritten: Ein neuronales Netz wurde trainiert, mithilfe eines Variational Auto Encoders (VAE) anhand von mehreren zehntausend Bildern zu lernen, wie die visuelle Information in einen 512-dimensionalen Vektor kodiert werden kann, der dann als Funktionstest nach Dekodierung das ursprüngliche Bild wieder rekonstruiert. Ein simultanes Verfahren wurde im 2. Schritt auf zehntausende Musikstücke (midi-files) angewendet, so wie im 1. Schritt einen Picture-Variational Outoencoder (PictureVAE) nun einen MusicVariationalAutoEncoder (MusicVAE) zu generieren. Dabei wurden mit einer frei wählbaren Note Color Map den Noten Farben usw. zugeordnet. Im 3. Schritt wurde in der Programmiersprache Python das entscheidende Translations neuronale Verbindungsnetzwerk geschaffen (TNN), um den MusicVAE mit dem PictureVAE zu verbinden. Als Ergebnis kann damit die neuronale KI biderektional Musik und Bilder verbinden. (Vgl.: K. Wienand und W. M. Heckl, The artificial synesthete: Image-melody translations with variational autoencoders, 2021,

https://arxiv.org/search/?query=heckl&searchtype=all&source=header).

Als Funktionstest dient dabei die selbständige wiederholte Interpretation eines Musikstücks in ein Kunstwerk durch die eigenständige KI, die zu ähnlichen Resultaten führt.

Viel Raum bleibt dabei zu spekulieren, ob die KI tatsächlich einen eigenständigen, vom analog arbeitenden menschlichen Künstler unabhängigen Mehrwert generieren kann, so wie man es von heutiger KI im Bereich der Mustererkennung, des menschlichen Sprachverständnisses oder der Vorschlagsalgorithmen auf einschlägigen Verkaufsportalen kennt.

Schon 1911 hat Wassily Kandinsky in seiner „Improvisation III“ mit seiner natürlichen Intelligenz als Künstler interpretiert, was er sah und fühlte während eines Konzerts.

Schon 1911 hat Wassily Kandinsky in seiner „Improvisation III“ mit seiner natürlichen Intelligenz als Künstler interpretiert, was er sah und fühlte während eines Konzerts.